在当下的AI热潮里,Token概念正逐渐占据重要位置。然而对于Token,很多朋友可能只是听过Token名词,但它到底代表了什么?又会以怎样的方式影响我们的日常?这篇文章,正是希望为您解答这一问题。

要回答这一问题,首先我们要了解Token的官方中文翻译和相关介绍。

在2026年3月23日举办的中国发展高层论坛年会上,国家数据局局长刘烈宏从官方角度,为Token给出了权威中文翻译:词元。他同时强调,词元(Token)不仅是智能时代的价值锚点,更是连接技术供给与商业需求的“结算单位”,为各类AI商业模式的落地,提供了可量化、可追溯的可能。

在这段话里,最值得我们关注的,就是“连接技术供给与商业需求的‘结算单位’”这一表述。

什么是结算单位?

我们可以用两个个最贴近生活的例子理解:日常用电,我们用“度”作为结算单位,电费多少全看用了几度电;日常用水,结算单位是“吨”,水费高低取决于用水量。

而当AI成为我们生活的消费品时,如何衡量我们使用了多少AI模型服务?答案,就是词元(Token)。它,就是AI用量的结算单位。

“词元(Token)”是什么?

在人工智能模型系统中,词元(Token)是模型处理信息的最小单元。

当我们向AI输入请求信息的时候,人工智能模型要想彻底弄清楚含义,都必须先将这些信息拆解成一个个最小的“词元”,才能进行分析和处理——这就像我们看书,要先认识每一个字,才能读懂一句话、一整篇文章。

我们用几个实际例子,详细说说用户输入的请求是如何被拆分为词元的:

例子1:假设我们现在打开了手机中最常用的AI应用并输入“今天天气怎么样?”这一问题,然后点击发送。

人工智能大模型在收到了我们的问题后,将会对“今天天气怎么样?”这一问题进行词元拆解,拆解后的词元可能是这样的:今天 / 天气 / 怎么样 / ?(注:不同模型拆分规则可能略有差异,另外请注意,标点符号也会被拆分为独立词元,因为 AI 模型需要识别语气和句式)

例子2:如果我们给AI的输入信息是“帮我写一篇关于春天的短文,要求300字左右,语言温柔”

拆解后的词元可能是:帮 / 我 / 写 / 一篇 / 关于 / 春天 / 的 / 短文 / , / 要求 / 300字 / 左右 / , / 语言 / 温柔

从这几个例子能看出,词元的拆分遵循“最小可理解单元”原则:不是简单按单个汉字拆分(比如“春天”不会拆成“春”和“天”),而是拆成我们日常交流中能独立表达基础含义的片段,这样模型才能准确理解我们的需求。

而AI生成回复时,同样离不开词元——它的回复,本质上是模型根据我们输入的词元,一步步“拼接”出新的词元,最终组成完整的句子。

比如我们问“今天天气怎么样?”,模型确定我们要查询的当下的气象信息后,就会调取相关数据,然后依次生成“今天 / 晴 / , / 气温 / 18 / – / 28 / ℃ / , / 微风 / , / 适合 / 出行”这样的词元序列,最终呈现出我们看到的完整回复:“今天晴,气温18-28℃,微风,适合出行”。

人工智能平台如何来计算“词元(Token)”用量?

AI平台统计词元用量的核心逻辑很简单:词元用量 = 输入词元数 + 输出词元数

为了便于您的理解,我们用以下这个示例场景,并且通过简化模拟的形式来向您讲解词元计算。(请注意:我这里特意强调“简化模拟”,因为本文重点是向您介绍“词元”这一概念,而“次元用量”涉及到的内容十分复杂,很难用简单的几行文字详细说明)

示例场景: 我们向AI询问“今天天气如何?” AI给出回复“今天晴,气温18-28℃,微风,适合户外活动。”

要计算以上示例场景中的词元消耗量,我们要把整个过程拆分成几步:

第一步:AI模型收到我们的问询后,将会计算输入词元数。我们输入的“今天天气如何?”,拆解后是4个词元(今天 / 天气 / 如何 / ?),所以输入词元数就是4。

第二步:AI处理请求。模型先识别这4个词元的含义,确定需求是“查询当日天气”,然后通过内置的接口在线查询实时气象数据。再对查询到的气象数据进行分析,转化为我们能看懂的自然语言。在这一步里,具体是否额外消耗词元,可能会根据您使用的不同AI平台,不同AI模型以及不同应用场景产生不同结果。在这一步里有可能需要消耗大量词元,也可能消耗很少甚至完全不需要消耗词元。为了便于您的理解,我们在这里就以不消耗词元作为示例。但请您务必留意,实际这一步的词元消耗情况,需要根据您的实际使用场景和具体人工智能模型以及平台规则来确定。

第三步:计算输出词元数。AI生成的回复“今天晴,气温18-28℃,微风,适合户外活动。”,拆解后是15个词元(今天 / 晴 / , / 气温 / 18 / – / 28 / ℃ / , / 微风 / , / 适合 / 户外 / 活动 / 。),所以输出词元数就是15。

第四步:统计总用量。这个场景下,我们总共消耗的词元数 = 输入4个 + 输出15个 = 19个词元(token)。

这里要注意几个细节:

- 不同AI平台的拆分规则有所差异(比如有的平台会把“18-28℃”拆成“18”“-”“28℃”三个词元),这也就是为什么我在这段开始的时候,提到了这里仅仅是模拟这个过程;

- 如果我们在对话中连续提问(比如接着问“明天呢?”),模型为了准确理解上下文、避免重复提问,会保留上一轮的全部上下文词元(比如上一轮我们的天气问题以及模型答复内容),这部分保留的上下文词元会和新提问的词元一起,计入新一轮的输入词元用量。所以连续对话的总用量会比单次提问略高。

- 在以上讲解的第二步里,我们按照不消耗词元这一场景为您阐述次元用量统计方法。但是,如果在这一步中大模型需要消耗词元,那么这第二步中消耗的词元数量是要计算到总的词元消耗中的。

“词元(Token)”与我们有什么关系?

可能有的朋友会觉得,我们每天都在用AI模型,和它聊天、查询信息、写文案,就算不知道词元(Token)用量,也不影响使用啊。

的确,就目前来说,如果我们使用AI模型仅仅停留在“手机应用聊天、简单信息查询”的层面,确实不需要特意了解词元用量——因为目前类似“豆包”,“元宝”,“千问”这类免费AI应用会给我们提供非常充分的词元使用额度,所以我们日常使用是感觉不到任何词元使用额度限制的。

但是,未来我们每个人都可能会像支付水费或电费一样来支付我们的词元(Token)用量。只不过形式可能是直接支付,或者是通过某种形式来间接支付。毕竟,AI平台在提供给我们服务的同时,要承担大量算力开销。而这些开销,肯定是需要通过某种方式来获得补偿,这样AI平台才能持续运行下去。

如果您不相信这一点,那么请让我用三个场景来解释:

1. 智能体应用的普及

关于智能体这个概念,也许有些朋友还不甚熟悉。但是我提一下“OpenClaw龙虾”,也许您会更有印象。

可能有朋友会问,OpenClaw龙虾和词元(Token)有什么关系?其实,OpenClaw龙虾本质上就是一款智能体工具——它能帮我们自动处理信息、完成指定任务(比如自动整理文档、筛选信息、甚至自动回复消息),而它每一次处理任务、分析信息、生成操作指令,都会消耗词元。

目前,智能体应用还处于早期阶段,还没有深入走进我们每个人的生活,但这个趋势已经非常明显。未来,我们的手机、家电、电脑里,都会运行着一个甚至多个智能体:手机里的智能助手能帮我们规划行程、处理工作消息;家电里的智能体能根据我们的习惯自动调节温度、开关设备;工作中的智能体能帮我们整理报表、撰写邮件——这些智能体在工作时,不仅会消耗电力和网络流量,更会消耗AI使用量,也就是词元(Token)。而这些消耗,最终都会通过服务费、设备购买或设备使用费等形式,由我们来承担。

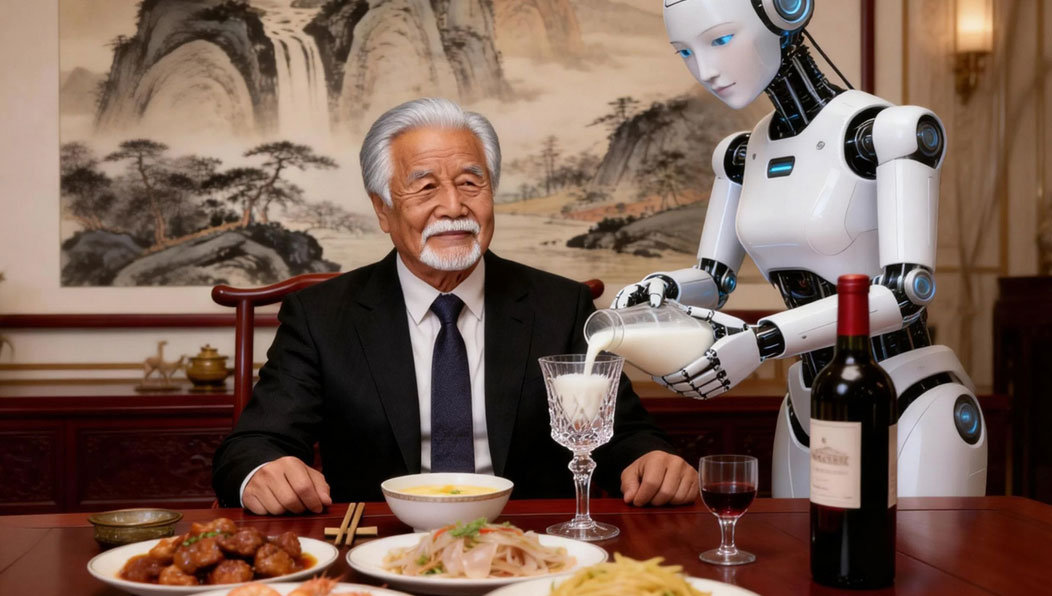

2. 具身智能机器人的普及

除了智能体,具身智能机器人的普及,也会让词元走进我们的生活。目前,国内的宇树机器人、国外的Optimus机器人等诸多厂商,都在全力推进具身智能机器人的研发和落地——虽然现在这些机器人还无法完全走进我们的日常生活,大多应用在工业、科研等领域,但我们已经能看到它未来走进家庭、走进工作场景的可能。

当具身智能机器人走进我们的生活,我们和它交流时(比如“帮我拿一杯水”“打扫一下客厅”),机器人会把我们的语音转化为文本词元,再拆解分析,理解我们的需求;而机器人自身通过硬件控制实现自主行动时(比如走路、拿东西、打扫卫生),会像自动驾驶一样,处理视觉、空间等多模态数据,消耗对应的词元。

简单来说,未来我们使用机器人的每一次指令、机器人的每一次行动,都会消耗词元。

当然,未来的模样,我们只能憧憬,很难完全具象化。词元(Token)这一概念究竟会以怎样的方式,一步步走进我们的生活、渗透到我们的日常,还需要交给时间来答复。

但有一点是肯定的:随着AI技术的不断发展,智能体、具身智能机器人等场景的逐步普及,词元(Token)绝不会一直是“小众概念”。它会像水电计量的“度”和“吨”一样,成为我们生活中不可或缺的一部分,成为我们使用AI服务、享受智能生活的“计量标尺”。